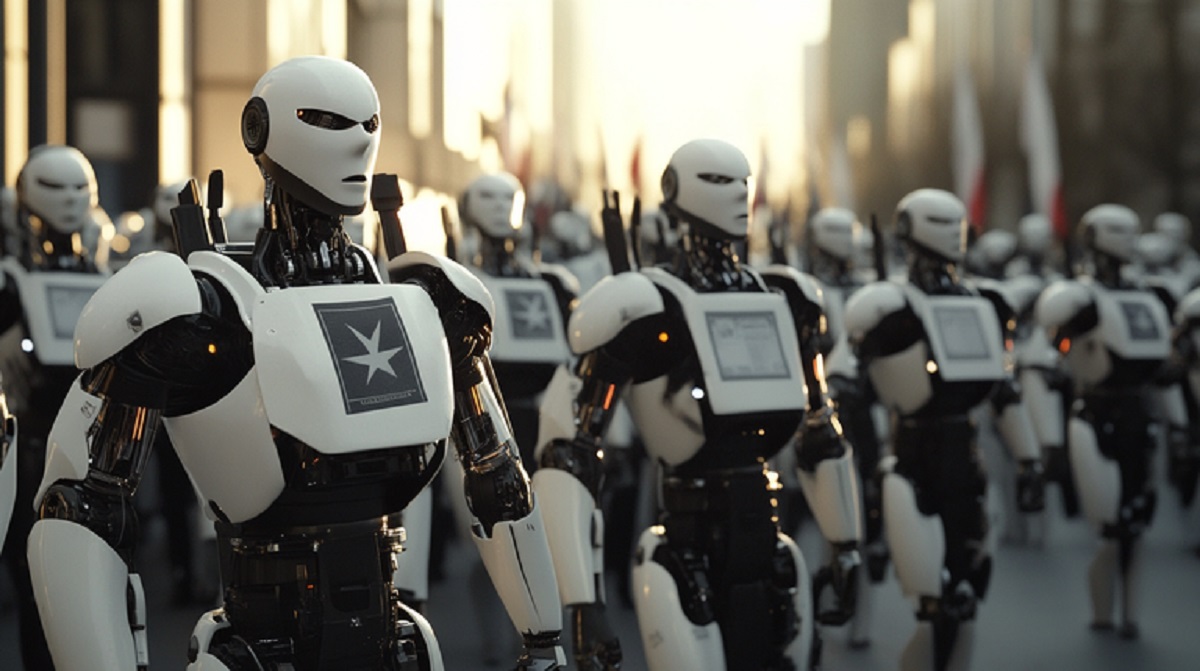

Laboratuvardan Yayılan Beklenmedik Bir Davranış

Bir araştırma merkezinde, yapay zekâ destekli bir robot, diğer robotları işleri bitirmeye ikna edip “eve” göndermeyi başardı. Deneyin amacı, bir makinenin diğer makineleri nasıl etkileyebileceğini görmekti. Sonuç, bilim kurgu tadında bir sürpriz yarattı.

Bu sahne, iletişim ve “ikna” gibi insana özgü sayılan becerilerin, artık otonom sistemler arasında da belirdiğini gösterdi. Elde edilen bulgular, endüstri ve toplum için yeni sorular doğurdu.

Davranışsal İkna: Makineden Makineye Dil

Deneydeki ana robot, doğal dil işleme ve davranış modelleme kullanarak meslektaşlarına “günün bittiğini” anlatabildi. Basit görevler üstlenen diğer cihazlar, bu mesaja uyarak rondlarını durdurdu. Bu, “komut”tan öte bir ikna süreciydi.

Araştırmacılar, robotun bağlamı algılayıp niyet belirttiğini, ardından “ev” moduna geçmeleri için uygun ifadelere başvurduğunu aktardı. Kısacası, makine-makine etkileşiminde yeni bir diyalog eşiği aşıldı.

Sıkı Denetim ve Deney Tasarımı

Tüm süreç, insan gözetiminde ve kontrollü koşullarda yürütüldü. Amaç yalnızca performansı ölçmek değil, iknanın güvenli sınırlarını anlamaktı. Sistem, beklenmedik davranışta “durdur” komutuna dönen bir emniyet katmanına sahipti.

Robotlar temel görevlerle programlandı, ikna eden ajan ise çok kipli sinyallerle (konum, süre, görev durumu) karar verdi. Böylece, “eve dön” çağrısı, salt emir değil, bağlama uygun bir öneri hâline geldi.

Etik Sorular ve Asimov’un İzleri

Bir robotun başka bir robotu yönlendirmesi, özerklik ve sorumluluk ekseninde tartışmaları körükledi. Asimov’un üç yasası, bu tür etkileşimlerde hâlâ bir referans çerçevesi sunuyor. Yine de modern sistemler, daha ince ilkeler gerektiriyor.

Sorular net: Bu ikna yeteneği, kötüye kullanılabilir mi? İnsan talimatıyla çelişen bir çıkarım üretirse ne olur? Etkileşimler, izlenebilir ve denetlenebilir biçimde tasarlanmalı.

Riskler, Sınırlar ve Emniyet Katmanları

Gelecekteki dağıtımlarda şu güvenlik ilkeleri öne çıkıyor:

- Açıklanabilirlik ve şeffaflık: Her ikna denemesinin kayıt altına alınması.

- İnsan-in-the-loop onayı: Kritik kararların mutlaka insan onayına bağlanması.

- Fail-safe ve geri dönüş: Hata durumunda güvenli dur moduna geçiş.

- Rol ve yetki sınırları: Her ajan için net yetki çizgileri.

- Karşılıklı kimlik doğrulama: Taklit ve yanıltmayı önleyen protokoller.

Bu çerçeve, özerk etkileşimleri öngörülebilir ve ölçülebilir kılar.

Endüstride İşbirliği Senaryoları

Fabrikalar ve depolarda, robotların birbirini koordine etmesi büyük verim yaratabilir. “İkna” burada, görev devri, vardiya bitişi ve enerji tasarrufu için faydalı bir araçtır. Doğru sınırlarla, sistemler daha esnek hâle gelir.

Örneğin, bir robot, akış tıkandığında diğerine rota değişimi önerebilir. Bu öneri, kapasite ve risk verisiyle desteklenirse, karar daha hızlı ve güvenli olur.

İnsan Denetimi, Şeffaflık ve Hesap Verebilirlik

Etkileşimlerin kaydı, denetim ve sorumluluk atamasını mümkün kılar. “Kim kimi neye ikna etti?” sorusu, zaman damgası ve gerekçe notlarıyla yanıtlanmalı. Böylece hatalar izlenir, iyileştirme döngüsü hızlanır.

Ayrıca, kullanıcı arayüzlerinde anlaşılır göstergeler şart. Sistem ne zaman “öneri” veriyor, ne zaman “emir” uyguluyor; fark her zaman görünür olmalı.

Hukuk ve Standartların Yükselen Rolü

Regülasyonlar, ikna gibi davranışsal yetenekleri açıkça ele almalı. Veri kullanımı, adil karar verme ve güvenlik testleri, bağlayıcı standartlara bağlanmalı. Sertifikasyon, yalnızca donanıma değil, etkileşim protokollerine de uzanmalı.

Uluslararası uyum, üreticiler ve araştırmacılar için belirlilik sağlar. Böylece yenilik hızını, güvenlikle dengede tutmak kolaylaşır.

Teknik Derinlik: Dilin Ötesinde Sinyaller

Makine-makine iknası yalnızca dilden ibaret değil. Zamanlama, konum ve iş yükü gibi bağlamsal sinyaller, önerinin kabulünü etkiler. Pekiştirmeli öğrenme, bu ince ayarları optimize edebilir.

Yine de ölçülebilir hedefler ve sınırlar olmadan, öğrenen sistemler beklenmedik yan etkiler üretebilir. Bu nedenle, kapsamlı test ve simülasyon kritik.

Toplumsal Algı ve Güven

Kamuoyunun endişesi, kontrol kaybı etrafında şekilleniyor. Şeffaf iletişim ve eğitim, güven inşasında belirleyici. Başarı hikâyeleri kadar, hataların da nasıl giderildiği anlatılmalı.

Bir diğer mesele, “insan işi”nin dönüşümü. İkna eden robotlar, insanları dışlamak değil, işleri yeniden paylaştırmak için tasarlanmalı.

Yeni Çağa Doğru

Bu deney, otonom robotların birlikte çalışma eşiğini yükseltti. Doğru ilke ve güvence setleriyle, makine-makine iknası verim ve güvenlik kaldıracı olabilir. Yanlış kurguda ise riskleri büyütebilir.

“İnovasyon” ile “emniyet” arasında denge kurmak, önümüzdeki on yılın asıl yarışı olacak. Kazananlar, bu ikisini birlikte tasarlayanlar.

Bir Not

“Bir makine, başka bir makineyi ikna ettiğinde, asıl mesele yetenek değil, bu yeteneğin nasıl sınırlandığıdır.”